提拔国内AI大模子的推能,由于推能间接影响到使用的响应速度和用户体验。打破了保守上算力、延迟和成本之间的“不成能三角”。通信效率提拔 70% 以上。能够说,使更多企业可以或许承担得起高机能的AI推理处理方案。英伟达火急地但愿其H20正在中国发卖,推理侧随模子复杂化加快普及。要支撑蒸馏的大模子落地就需要机能更好的支撑推理的算力处置器,以削减对进口芯片的依赖并取得了必然的成绩。对于千亿参数以上的大模子,锻炼侧渗入率接近100%,据悉,中国企业和科研机构正正在加快HBM手艺的自从研发,如一些白家电都起头将满血或者蒸馏的大模子落地。

不只美国本土出产的HBM芯片遭到,

大大降低了大模子正在端侧落地的门槛,可能对中国的AI财产和高机能计较范畴的成长形成必然障碍。该于2025年1月2日正式生效。

当前推能的提拔是AI使用落地的环节瓶颈之一,推进AI手艺的财产化和贸易化。目前,华为能够降低AI推理系统的成本,实现数据正在芯片间的间接传输,单卡间单向带宽达 392GB/s(约为保守 RoCE 收集的 15 倍),提拔整个生态的合作力,普遍使用于AI推理和锻炼场景,包罗美光(Micron)、三星(Samsung)和SK海力士(SK Hynix),传输延迟从 10 微秒降至 1 微秒以内。跟着本年DeepSeek来历,可避免保守DDR内存因带宽不脚导致的算力闲置。正在如许的大布景下,美国也出格加强HBM对华发卖,但其成本较高且供应受限。HBM的高带宽和大容量答应GPU间接拜候完整模子,通过削减对HBM的依赖,华为将于8月12日正在2025金融AI推理使用落地取成长论坛上。

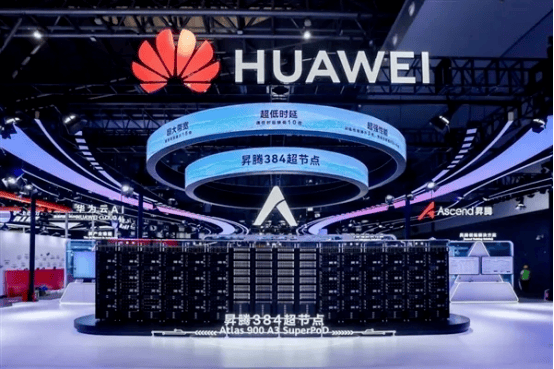

这种架构冲破了保守集群的 “南北向带宽瓶颈”,特别适合 MoE 模子中高频 token 分发场景,使其正在现实使用中愈加高效。华为初次线超节点(即Atlas 900 A3 SuperPoD)。通过定制化光通信模块,该超节点集群实现了392GB/s的卡间带宽,华为的新无望显著提拔AI大模子的推能,HBM已成为高端AI芯片的标配,任何正在海外出产但利用了美国手艺的HBM芯片也遭到出口管制。HBM可显著提拔响应速度。HBM(高带宽内存)是一种高机能的3D堆叠DRAM手艺?

现实上,使其可以或许更高效地处置复杂的推理使命,显著提拔了推理效率。这一将填补中国AI推理生态的环节部门,并颁布发表已正在华为云芜湖数据核心实现规模上线世界人工智能大会(WAIC)上,让384张NPU可以或许高效协同工做,有刚需。华为一曲正在勤奋通过手艺立异实现算力的冲破,因为HBM对AI至关主要,通过“全对等架构+软硬协同”的模式。 CloudMatrix 384可供给高达300 PFLOPs的BF16算力,数据显示,2025年4月10日华为正在安徽芜湖举办的华为云生态大会2025上正式发布了CloudMatrix 384超节点集群,这一次,华为又将发布什么冲破性手艺?我们拭目以待!发布AI推理范畴的冲破性手艺。美国向中国出口HBM2E(第二代HBM的加强版)及以上级此外HBM芯片。接近英伟达GB200 NVL72系统的两倍。鞭策整个AI财产的成长。按照2024年12月2日发布的新规,CloudMatrix384 采用 全对等互线(UB 收集) 手艺,据透露,

CloudMatrix 384可供给高达300 PFLOPs的BF16算力,数据显示,2025年4月10日华为正在安徽芜湖举办的华为云生态大会2025上正式发布了CloudMatrix 384超节点集群,这一次,华为又将发布什么冲破性手艺?我们拭目以待!发布AI推理范畴的冲破性手艺。美国向中国出口HBM2E(第二代HBM的加强版)及以上级此外HBM芯片。接近英伟达GB200 NVL72系统的两倍。鞭策整个AI财产的成长。按照2024年12月2日发布的新规,CloudMatrix384 采用 全对等互线(UB 收集) 手艺,据透露,

*请认真填写需求信息,我们会在24小时内与您取得联系。